加我微信:laozhangdaichong7。确保你能用上 ChatGPT 官方产品和解决 Plus 升级的难题。本站相关服务↓

- ChatGPT一直转圈,专用网络美国海外专线光纤:老张渠道八折优惠。立即试用>

- GPT3.5普通账号:美国 IP,手工注册,独享,新手入门必备,立即购买>

- GPT-4 Plus 代充升级:正规充值,包售后联系微信:laozhangdaichong7。下单后交付>

- OpenAI API Key 独享需求:小额度 GPT-4 API 有售,3.5 不限速。立即购买>

- OpenAI API Key 免费试用:搜索微信公众号:紫霞街老张,输入关键词『试用KEY』

下单后立即获得账号,自助下单 24小时发货。很稳定,哪怕被封免费换新,无忧售后。

立即购买 ChatGPT 成品号/OpenAI API Key>>

请点击,自助下单,即时自动发卡↑↑↑

OpenAI开发系列:Completions模型的工作原理

- 了解OpenAI的GPT系列模型

OpenAI的GPT(Generative Pre-trained Transformer)系列模型是一种基于Transformer架构的自然语言处理(NLP)模型。该系列包括多个预训练模型,如GPT-1、GPT-2和GPT-3等。这些模型在NLP领域享有很高的声誉,并在多个任务上取得了领先的性能。

OpenAI的GPT模型采用了无监督学习方法,通过大量的无标签数据进行预训练,从而使模型具备了广泛的语言理解和生成能力。这使得GPT模型可以在各种NLP任务上表现出色,如文章生成、对话系统、问答系统等。

与传统的机器学习模型不同,OpenAI的GPT模型不需要针对特定任务进行额外训练。相反,开发者可以直接利用OpenAI的API接口来发送文本提示并获得模型的响应。这为开发者提供了便利,不需要自行训练和部署大型模型,而是直接使用OpenAI的服务。

获取OpenAI API的访问权限非常简单。开发者只需注册OpenAI API并获取API密钥即可开始使用。OpenAI API为开发者提供了多种预训练模型可供选择,根据不同的应用需求和要求选取最适合的模型。

在接下来的笔记中,我们将深入了解OpenAI GPT系列模型的工作原理以及如何在实际应用中使用它们。

首先,让我们来介绍开发使用Completions模型的AI应用的流程。

开发使用Completions模型的AI应用的流程

在开发使用Completions模型的AI应用时,我们需要经过以下流程:

1. 确定需求:在开发任何应用之前,我们需要明确应用的目标和需求。这包括确定应用的功能和应用场景,例如生成文本、语音合成或图像处理等。

2. 数据准备:为了训练和优化AI模型,我们需要准备相关的数据集。这可能涉及收集和整理文本、音频或图像等数据,并进行预处理和标注。

3. 模型训练:使用准备好的数据集,我们可以开始训练AI模型。这涉及将数据输入到Completions模型中,然后使用反向传播和优化算法来调整模型的参数,以使其能够更好地完成任务。

4. 调优与优化:在模型训练过程中,我们需要进行调优和优化以提高模型的性能。这可能涉及调整模型的超参数、增加训练迭代次数或更改优化算法等。

5. 模型评估:训练完成后,我们需要评估模型的性能。这可通过使用测试数据集来进行模型推理,并计算其在不同评估指标上的表现来实现。

6. 部署与集成:一旦模型通过评估,并且确保满足需求,我们可以将其部署到生产环境中。这可能涉及将模型集成到现有系统中,或者开发一个新的应用程序来使用模型提供的功能。

以上是开发使用Completions模型的AI应用的一般流程。我们可以根据具体的应用需求和情况进行适当的调整和优化。

接下来,让我们深入探讨一个使用Completions模型的AI应用流程中的一个具体功能:Function calling。

解释Function calling功能的实际应用流程与案例解析

Function calling是Completions模型中的一个功能,它可以帮助我们实现根据用户提供的函数名和参数来生成相应的代码。

实际应用流程如下:

1. 用户输入:用户通过界面或命令行等方式提供函数名和参数。

2. 模型输入:将用户提供的函数名和参数传递给Completions模型作为输入。

3. 生成代码:模型使用输入的函数名和参数来生成相应的代码。

4. 返回结果:将生成的代码返回给用户。

让我们通过一个案例来解析Function calling功能的应用流程。

假设我们正在开发一个文本编辑器应用,用户希望通过指定函数名和参数来执行相应的操作,例如插入文本、删除文本或替换文本等。

用户输入:用户通过界面输入函数名和参数,例如要求插入文本的函数名为”insert_text”,参数为要插入的文本内容。

模型输入:将用户提供的函数名和参数传递给Completions模型作为输入。

生成代码:模型根据输入的函数名和参数生成相应的代码,例如生成一行代码进行文本插入操作:`editor.insert_text(“Hello, World!”)`。

返回结果:将生成的代码返回给用户,用户可以在编辑器中执行该代码,从而实现相应的操作。

通过Function calling功能,用户可以方便地通过提供函数名和参数来生成相应的代码,而无需自己编写复杂的代码逻辑。

接下来,我们需要探讨如何优化Function calling功能的流程以及如何实现多轮对话。

探讨Function calling功能的流程优化与多轮对话实现

为了优化Function calling功能的流程,可以考虑以下几个方面:

1. 自动提示:在用户输入函数名和参数时,可以提供自动提示功能,以帮助用户快速选择合适的函数名和参数。这可以通过使用预定义的函数名和参数列表来实现。

2. 参数检查:在用户输入参数时,可以对参数进行检查和验证,以确保参数的有效性和完整性。例如,可以检查参数的数据类型、范围和必填性等。

3. 错误处理:在生成代码时,应考虑错误处理机制。例如,如果用户提供的函数名或参数无效,应提供相应的错误提示并提示用户进行修正。

4. 多语言支持:为了提高应用的灵活性和适用性,可以考虑支持多种编程语言,使用户能够根据自己的需求选择合适的编程语言。

实现多轮对话的基本思路是通过保存上下文信息,使得模型在不同对话轮次中能够理解先前的对话内容并做出连贯的响应。

同时,为了提供更好的用户体验,可以考虑以下优化措施:

1. 上下文保存:在每一轮对话中,保存上一轮对话的上下文信息,以便下一轮能够理解先前的对话内容。

2. 上下文扩展:根据用户的输入,将上下文信息逐渐扩展,以便模型能够理解更复杂的语境和更深入的对话。

3. 用户确认:在生成代码之前,可以向用户展示生成的代码,并要求用户进行确认。这样可以减少不必要的错误和误操作。

通过优化Function calling功能的流程和实现多轮对话,可以提高用户的使用体验和开发效率。

最后,让我们讨论一下本地调用OpenAI接口进行开发调试的两种方式:直连和代理转发。

本地调用OpenAI接口的两种方式:直连和代理转发

当开发和调试使用Completions模型的AI应用时,我们可以选择直连本地调用OpenAI接口,或者通过代理转发方式进行调用。

1. 直连方式:直连方式是指直接从本地应用程序中通过网络请求向OpenAI接口发送请求,并从接口获取模型的返回结果。这种方式通常需要在本地开发环境中进行配置和测试,可以更快地获得模型的调试结果。

2. 代理转发方式:代理转发方式是指在本地应用程序和OpenAI接口之间使用一个代理服务器作为中间层,将本地请求转发给OpenAI接口,然后将接口的返回结果转发回本地应用程序。这种方式通常用于在开发环境和生产环境之间进行调试和测试,可以模拟实际请求和响应的流程。

无论是直连方式还是代理转发方式,我们都需要在开发和测试过程中确保请求和响应的准确性和可靠性,并确保与OpenAI接口之间的连接安全和稳定。

通过本地调用OpenAI接口的方式,我们可以更方便地开发和调试使用Completions模型的AI应用,从而提高应用的性能和用户体验。

以上是开发使用Completions模型的AI应用的流程以及其中的Function calling功能、流程优化和多轮对话实现的探讨,以及本地调用OpenAI接口的两种方式。根据具体的应用需求和场景,我们可以相应地进行调整和优化,以提高应用的效果和用户满意度。

GPT-4 Turbo的升级功能

2022年,OpenAI的CEO阿尔特曼在开发者大会上宣布了GPT-4 Turbo的即将发布及其升级功能,引起了广泛的关注。GPT-4 Turbo被认为是当前AI技术的最新巨大突破,其升级功能将为用户带来更出色的体验和更广阔的应用领域。

GPT-4 Turbo的数据和功能

GPT-4 Turbo是基于GPT-4衍生而来的版本,它在处理大规模数据上具有更快的速度和更高的准确性。根据CEO阿尔特曼的介绍,GPT-4 Turbo在推理速度上比GPT-3提高了10倍,这将极大地提高用户的交互体验。此外,GPT-4 Turbo还具备更强大的自学习能力和更深入的语义理解,可以更好地理解和回答用户的问题。

与之前的版本相比,GPT-4 Turbo还引入了一种全新的训练方法,使其能够从更多的互联网内容中进行学习,包括在线文档、新闻文章、社交媒体帖子等。这将使GPT-4 Turbo具备更广泛的知识和更深入的理解能力,进一步提高其回答问题的准确性和质量。

GPT-4 Turbo的中文含义和背后意义

GPT-4 Turbo作为GPT-4系列的升级版,其中文含义中的”Turbo”一词意味着强大的速度和性能。”Turbo”源于汽车工业术语,指的是通过增加发动机的排气量或采用增压系统,以达到更强大的动力输出。在GPT-4 Turbo中,这个词的使用意味着它具备了更快的处理速度和更高的性能。

对于用户来说,GPT-4 Turbo的发布意味着更高效、更流畅的使用体验。无论是在问答交互中还是在文本生成领域,GPT-4 Turbo都将能够以更快的速度提供准确的答案和内容。这将在各个领域带来巨大的影响,如教育、医疗、商业等。

GPT-4 Turbo的相关优势和特点

除了更快的推理速度和更高的准确性之外,GPT-4 Turbo还具备其他一些独特的优势和特点。首先,它可以自动从更多的互联网内容中进行学习,从而获得更丰富的知识和语言模型。其次,GPT-4 Turbo可以根据用户的反馈进行自我调整和优化,从而提供更适应用户需求的答案。

此外,GPT-4 Turbo还具备更强大的多语言处理能力,能够接受多种语言的输入并提供准确的回答。这使得GPT-4 Turbo在跨国公司、国际交流等场景中具备重要的应用价值。

总的来说,GPT-4 Turbo的发布将引领AI技术的新一波升级与发展。它的更快速度、更高准确性以及其他独特的优势将为用户带来更出色的体验,进一步推动AI技术在各个领域的应用和发展。

OpenAI开发工具概述

OpenAI是一家在人工智能领域知名的公司,提供各种强化学习相关的研发工具包,其中最重要的之一就是OpenAIGym。OpenAIGym是一个强化学习算法开发和比较的工具,它提供了多种环境和任务,帮助开发者进行模型训练和算法优化。

OpenAIGym的功能

作为一个强化学习算法的开发工具,OpenAIGym具有以下主要功能:

- 环境模拟:OpenAIGym提供了多种环境和任务,包括经典的控制任务和现实世界的仿真任务等。这些环境可以帮助开发者在模拟环境中测试和训练算法模型。

- 算法比较:OpenAIGym提供了一系列经典的强化学习算法,例如Q-learning、深度Q网络(DQN)和策略梯度等。通过在相同的环境中运行不同的算法,开发者可以比较它们的性能和效果。

- 工作流集成:OpenAIGym可以与其他机器学习和深度学习框架集成,例如TensorFlow和PyTorch等。这使得开发者能够更方便地在实际项目中使用OpenAIGym进行模型训练。

OpenAIGym提供的环境和任务

OpenAIGym提供了多种环境和任务,帮助开发者进行强化学习模型的测试和训练。

| 环境名称 | 任务描述 |

|---|---|

| CartPole-v0 | 控制一个摇摆杆使其保持平衡 |

| Pong-v0 | 通过控制挡板在屏幕上反弹球,与对手对战 |

| MountainCar-v0 | 控制汽车穿越山谷,到达目标点 |

这些环境提供了不同的复杂度和挑战性,可以帮助开发者逐步提高模型的性能和稳定性。

openai开发的常见问答Q&A

A. OpenAI开发系列(六):Completions模型的工作原理及应用实例……

Q: 什么是OpenAI的Completions模型?

A: OpenAI的Completions模型是一种基于自然语言处理(NLP)的模型,其主要用途是根据用户提供的文本提示,生成相关的文本补全。它可以通过模仿大量的训练数据,学习到自然语言的语法、语义和逻辑,从而能够在无需用户显式指定的情况下,自动完成用户的文本输入。

子点:

- Completions模型的核心功能是生成下一个合理的文本片段,这通常包括下一个单词或短语。

- Completions模型可以根据上下文信息来预测合适的补全文本,例如在写作中,它可以根据前面的句子来生成下一个连贯的句子。

- Completions模型可以应用于各种任务,如自动摘要、智能客服、代码自动补全等。

Q: Completions模型的工作原理是什么?

A: Completions模型采用了深度学习中的预训练和微调的方法。首先,模型通过大规模的语料库进行预训练,学习到语言的一般规律和语义表示。然后,通过在特定任务上微调模型,使其适应特定的应用场景。微调的过程包括迭代地训练模型,通过与人类专家提供的示例进行比较和修正,以提高模型的性能。

子点:

- 预训练阶段:模型使用自监督学习的方法,通过上下文和目标任务自动生成训练样本,并利用预训练的方法进行模型参数的初始化。

- 微调阶段:模型使用有监督学习的方法,通过人工标注的样本进行训练,优化模型参数以适应特定的任务要求。

Q: Completions模型的应用实例有哪些?

A: Completions模型具有广泛的应用前景,以下是其中几个典型的应用实例:

子点:

- 智能客服:通过Completions模型,可以实现更加智能、精准的人机对话,帮助用户解决问题、提供个性化的服务。

- 自动摘要:Completions模型可以通过生成连贯的文本补全,自动提取出文章或文本的关键信息,生成摘要。

- 代码自动补全:在编程过程中,Completions模型可以根据已有的代码片段,预测下一个合适的补全代码,提高开发效率。

A. OpenAI实现智能客服的开发流程

Q: OpenAI实现智能客服的开发流程是怎样的?

A: 实现智能客服的开发流程主要包括以下几个步骤:

- Step 1: 定义需求和目标 – 确定智能客服的具体功能和服务目标,如提供的服务类型、响应时间等。

- Step 2: 数据准备和清洗 – 收集和整理相关数据,包括用户问题、常见问题、知识库等内容。

- Step 3: 模型训练和优化 – 使用Completions模型进行训练和优化,通过反复调整模型参数和训练样本,提高模型的准确性和效果。

- Step 4: 系统集成和部署 – 将训练好的模型集成到客服系统中,并进行系统测试和调优。

- Step 5: 迭代和改进 – 根据实际使用情况和用户反馈,不断迭代和改进智能客服系统,提高用户体验和服务质量。

Q: 智能客服系统能够提供什么样的服务?

A: 智能客服系统可以提供以下几种服务:

- 快速响应用户问题:智能客服系统能够快速分析用户的问题,并给出准确的答案或建议。

- 个性化服务:智能客服系统可以根据用户的个人喜好和历史记录,提供个性化的推荐和建议。

- 知识库查询:智能客服系统可以根据用户输入的关键词,在知识库中查询相关内容,并进行答复。

A. Open AI首次开发者大会做了三件事:升级、降价、拓展生态

Q: Open AI首次开发者大会做了哪三件事?

A: Open AI首次开发者大会做了以下三件事:

- 升级:Open AI宣布推出最新版本的GPT-4 Turbo,该版本有更强的AI能力和更高的代码生成质量。

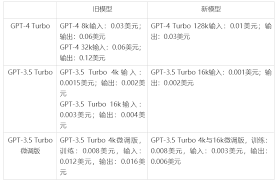

- 降价:Open AI宣布降低API使用费用,以降低开发者使用AI的成本,提高AI的普及率。

- 拓展生态:Open AI表示将进一步扩大合作伙伴生态系统,开放API接口,吸引更多开发者加入。

A. OpenAI软件研发工具

Q: OpenAI的软件研发工具有哪些?

A: OpenAI的软件研发工具主要包括以下几个方面:

- OpenAIGym:一款用于开发和比较强化学习算法的工具。提供了多种环境和任务,可以帮助开发者进行模型训练和评估。

- OpenAIHub:一个开发者社区平台,提供了大量的资源和教程,帮助开发者进行交流、学习和分享。

- OpenAIDevelopersAPI:一套用于开发者的API接口,可以直接调用OpenAI的模型和服务,加快开发效率。

A. OpenAI开发系列(十五):AI敏捷开发的新范式:利用大模型优化…

Q: 什么是AI敏捷开发?

A: AI敏捷开发是一种新的开发方法,通过利用嵌入模型和大规模训练的大模型,实现快速迭代和优化模型性能的目标。相比传统的开发方法,AI敏捷开发可以在不同的任务和数据集上引入预训练的大模型,通过微调和调优的方式,快速构建具有高性能和通用性的AI应用。

子点:

- AI敏捷开发可以通过复用预训练的大模型,避免从头开始训练模型的时间和资源消耗。

- AI敏捷开发可以通过少量的微调和优化,快速适应特定任务的需求,提高模型的性能和准确度。

- AI敏捷开发可以实现快速迭代和优化,使开发者能够更加高效地进行模型开发和部署。

Q: 大模型优化的关键技术有哪些?

A: 大模型优化涉及以下几个关键技术:

- 参数初始化:通过预训练的方式,初始化模型的参数,使模型具备一定的语义理解和语法规则。

- 微调策略:根据特定的任务需求和样本分布,制定合适的微调策略,如调整学习率、迭代次数等。

- 数据扩充:通过生成合成的数据样本,增加训练数据的多样性,从而提高模型的泛化能力。

A. 如何解决本地开发调用OpenAI接口的问题_openai tts 接口调…

Q: 在本地开发中,如何调用OpenAI接口解决调试问题?

A: 在本地开发中,可以通过以下两种方式调用OpenAI接口解决调试问题:

- 直连:直接将本地开发环境与OpenAI接口直接连接,在本地调试和调用OpenAI的功能和服务。

- 代理转发:通过代理服务器转发本地开发环境的请求和响应,间接调用OpenAI接口进行开发和调试。

子点:

- 直连:直连是一种简单粗暴的方式,可以快速进行开发调试。但需要注意的是,直连要求本地开发环境具备访问OpenAI的网络环境和权限。

- 代理转发:代理转发是一种间接调用OpenAI接口的方式,适用于无法直接访问OpenAI的网络环境和权限。代理转发可以进一步分为两种类型,具体方式和实现视具体情况而定。

A. OpenAI首届开发者大会最新爆料,全新UI可定制GPT,xAI大模型…

Q: OpenAI首届开发者大会的最新爆料有哪些?

A: OpenAI首届开发者大会的最新爆料包括以下几个方面:

- 全新UI可定制GPT:OpenAI宣布推出全新的GPT版本,具有可定制的用户界面,用户可以根据需要自定义界面的样式和功能。

- xAI大模型:OpenAI将继续投入研发大模型技术,使其具备更强的AI能力和更高的性能。

- 开发者API优惠:OpenAI宣布开发者API费用的优惠政策,降低使用AI的成本,促进AI技术的普及。

A. OpenAI公司的GPT系列模型在NLP领域中的领先地位

Q: OpenAI公司的GPT系列模型在NLP领域中有何优势?

A: OpenAI公司的GPT系列模型在NLP领域中具备以下优势:

- API接口:GPT系列模型提供了API接口,开发者可以直接向模型发送文本提示,并获取模型生成的响应,方便快捷。

- 预训练模型:GPT系列模型是经过大规模预训练的,学习了丰富的语法、语义和逻辑规律,能够生成准确、连贯的响应。

- 无需自行训练和部署:GPT系列模型已经进行了大量的训练和优化,开发者无需自行训练和部署大型模型,可以直接利用OpenAI的服务。

A. 注册OpenAI API:首先,需要在OpenAI官网注册并获取API密钥。这将允许您访问OpenAI提供的各种AI服务。

Q: 如何注册OpenAI API并获取API密钥?

A: 注册OpenAI API并获取API密钥的步骤如下:

- 访问OpenAI官网。

- 点击注册按钮,填写相关信息,并同意相应的条款和政策。

- 完成注册后,登录您的OpenAI账号。

- 在账号设置页面找到API密钥部分,生成并保存您的API密钥。

子点:

- 注册OpenAI API可以免费获得一定的API调用额度,可以用于尝试和开发。

- 如果需要更高的API调用限额或额外的服务,可以根据需求和实际情况购买更高级别的API套餐。

- 使用API密钥时需要注意保密,避免泄露给他人导致数据安全问题。

A. 北京时间11月7日凌晨,在OpenAI首次开发者大会上,CEO阿尔特曼(Sam Altman)用45分钟的时间公布了过去一年中GPT的各项数据,以及最新版本GPT-4 Turbo的升级功能。

Q: OpenAI首次开发者大会上的重要爆料有哪些?

A: OpenAI首次开发者大会上的重要爆料包括以下几个方面:

- 过去一年的数据公布:OpenAI CEO阿尔特曼(Sam Altman)公布了GPT模型的各项数据,包括模型参与的任务数量、总计的训练次数等。

- GPT-4 Turbo的升级功能:OpenAI推出了最新版本的GPT-4 Turbo,该版本具有更强的AI能力和更高的代码生成质量。