加我微信:laozhangdaichong7。确保你能用上 ChatGPT 官方产品和解决 Plus 升级的难题。本站相关服务↓

- ChatGPT一直转圈,专用网络美国海外专线光纤:老张渠道八折优惠。立即试用>

- GPT3.5普通账号:美国 IP,手工注册,独享,新手入门必备,立即购买>

- GPT-4 Plus 代充升级:正规充值,包售后联系微信:laozhangdaichong7。下单后交付>

- OpenAI API Key 独享需求:小额度 GPT-4 API 有售,3.5 不限速。立即购买>

- OpenAI API Key 免费试用:搜索微信公众号:紫霞街老张,输入关键词『试用KEY』

下单后立即获得账号,自助下单 24小时发货。很稳定,哪怕被封免费换新,无忧售后。

立即购买 ChatGPT 成品号/OpenAI API Key>>

请点击,自助下单,即时自动发卡↑↑↑

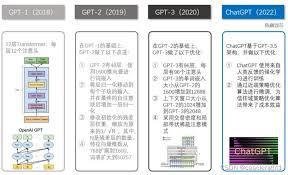

ChatGPT训练流程概述

ChatGPT是一种基于大规模无监督数据训练的语言模型,其训练流程主要包括四个步骤:预训练、有监督微调、奖励建模和强化学习。下面将详细介绍每个步骤的内容。

1. 预训练

预训练是ChatGPT的第一步,它通过在海量互联网语料库上学习世界上的知识,让模型具备强大的语言理解和生成能力。预训练阶段使用了Transformer结构,在大规模数据上进行无监督学习。具体来说,预训练步骤包括以下几个阶段:

- 数据收集和清洗:从互联网上收集大规模的文本数据,并进行清洗和处理,以去除无关信息。

- Tokenization:将文本分割成多个token,使得模型能够理解和处理更加细粒度的语言单位。

- 语言模型预测:通过预测缺失的token来训练模型,使其学会对输入文本进行建模和预测。

- 自回归训练:通过将文本中的每个token预测为下一个token,训练模型在给定前面文本的情况下生成下一个合理的token。

2. 有监督微调

有监督微调是为了让ChatGPT的模型在特定任务上进行个性化和精细化的训练,以提高其在特定领域的表现。在这个阶段,将准备标注的训练数据,并将其配对为问题-回答的形式。使用这些配对数据,通过监督学习的方式微调预训练模型,使其能够根据给定问题生成合理的回答。

3. 奖励建模

奖励建模是为了改进ChatGPT生成的回答的质量和准确性。在这个阶段,使用强化学习的方法,使用人类专家或在线用户提供的示例来评估生成的回答的质量。通过与参考答案进行比较,给予模型正面或负面奖励,以指导其生成更好的回答。这种奖励建模的方法可以让模型逐渐提升其回答的准确性和可读性。

4. 强化学习

强化学习是为了让ChatGPT的模型能够在与用户的实时对话中进行自我优化和改进。在这个阶段,使用强化学习算法,模型根据与用户的交互来调整自己的回答策略,使得其能够更好地理解用户意图并生成更加合理和符合上下文的回答。

通过以上四个步骤的训练,ChatGPT能够在对话中产生准确、连贯且具有逻辑的回答,并具备适应不同领域和任务的能力。

预训练

无监督预训练

- 数据收集:利用网络爬虫技术从互联网收集大量文本数据,并选择公开数据集。

- 数据清洗:对原始数据集进行清洗和处理,以保证数据的质量和一致性。

- 数据处理:构建训练集并准备文本数据以进行预训练。

- 模型训练:利用Transformer结构进行预训练,让ChatGPT学习文本中的语言知识和上下文关联性。

微调

监督微调

在监督微调阶段,ChatGPT将使用有标签的数据集进行训练,以学习特定的任务。监督微调有助于ChatGPT理解并回答与特定主题相关的问题。

指令微调

指令微调是ChatGPT的最后一个微调阶段,它旨在让ChatGPT在与用户的交互中更好地理解和执行指令。在指令微调阶段,ChatGPT将接受来自用户的指令,并生成相应的响应。

有监督微调

在ChatGPT的训练过程中,有监督微调是一个关键的阶段。这个阶段的目的是通过使用人工构造的prompt来对预训练的模型进行微调,使其更好地适应特定的任务或领域。

准备数据集

在进行有监督微调之前,我们需要准备一个用于训练的数据集。这个数据集包括两部分:input/output生成的prompt和用于训练的文本。

– 收集input/output生成的prompt用于训练:为了让ChatGPT能够生成合理的回复,我们需要提供一些示例对话或问题。这些示例对话可以是人工构造的,也可以是从真实对话中提取的。通过对这些prompt进行微调,模型可以学习到如何生成符合预期的回复。

– 收集文本用于训练,让模型补全prompt:除了input/output生成的prompt之外,我们还需要提供一些文本让模型进行训练。这些文本可以是从互联网上收集到的,可以是新闻文章、博客文章、社交媒体帖子等。通过对这些文本进行微调,模型可以学习到更丰富的语言知识和背景信息,从而提高回复的质量和多样性。

有监督微调

有监督微调是在预训练的模型基础上进行的进一步训练,目的是调整模型以适应特定的任务或领域。在微调阶段,ChatGPT使用基于有监督学习的方法。

具体来说,模型会根据输入的对话历史和上下文信息,生成回复文本序列,并根据真实的回复文本序列进行训练。通过反复调整模型参数,使得生成的回复尽可能接近真实的回复。

有监督微调阶段通常会涉及大量的标注数据。这些标注数据是通过人工提供的,可以是从真实对话中提取的,也可以是人工构造的。模型会根据这些标注数据进行训练,从而学习到如何生成准确、流畅的回复。

通过有监督微调,模型可以提高在特定任务或领域中的表现,进一步增强其语言理解和生成能力。

参考链接:如何解决OpenAI API错误代码429:请求过多(429错误openai)

奖励建模

奖励建模是ChatGPT模型训练的第三个阶段。在这个阶段,通过引入奖励信号和策略梯度算法,以及与人类演示者的交互,训练模型并改进生成结果,进一步提高模型生成高质量相关内容的能力。

1. 训练策略

在奖励建模阶段,我们使用强化学习方法训练模型。这种方法通过与人类演示者的交互,以及强化学习算法中的策略梯度方法,对模型进行训练和优化。

与人类演示者的交互可以通过向模型提供一系列问题和参考回答来实现。模型根据这些参考回答生成自己的回答,而人类演示者则对模型的回答进行评分。这种评分可以作为奖励信号,指导模型生成更准确、连贯的回答。

2. 奖励模型训练

奖励模型是通过人工标注的「排序模型(Ranking Model)」训练得到的。它可以根据模型生成的回答与人类演示者提供的参考回答之间的相似度来评估回答的质量。

在奖励模型训练阶段,我们利用奖励信号调整模型参数,从而改善生成结果。通过与人类演示者的交互,模型可以逐渐学习到如何生成更合理、更准确的回答,进而提高整体的生成能力。

强化学习

强化学习是机器学习的范式和方法论之一,用于描述和解决智能体在与环境的交互过程中通过学习策略以达成回报最大化或实现特定目标的问题。

- 策略优化:强化学习的核心思想是通过优化模型的策略来达到目标。在强化学习中, 我们通常会使用一种算法, 如PPO(Proximal Policy Optimization), 通过与对话策略优化器进行交互, 不断学习并改进模型的策略。这种策略优化的过程可以使模型逐渐趋于最优, 提高模型的性能和准确度。

- 基于用户反馈调整模型:为了进一步提高模型的性能和准确度, 强化学习可以利用用户反馈来调整模型。一种常见的方法是使用奖励模型, 用户可以对模型输出的候选结果进行比较和打标签, 从而训练得到一个奖励模型。然后, 强化学习算法可以使用这个奖励模型, 如PPO算法, 对模型进行进一步训练和优化。

强化学习的应用

强化学习在许多领域都有广泛的应用。以下是一些常见的应用领域:

- 自动驾驶汽车:强化学习可以训练汽车在不同的交通环境中做出正确的决策和行为,提高驾驶安全性和效率。

- 智能游戏玩家:强化学习可以帮助游戏玩家通过与游戏环境的交互,学习到最佳的游戏策略,提高游戏的竞技性和娱乐性。

- 机器人控制:强化学习可以训练机器人学习并执行复杂的任务,如抓取物体、导航等。

- 推荐系统:强化学习可以根据用户的反馈和偏好,优化推荐算法,提供更准确和个性化的推荐结果。

强化学习的挑战与展望

尽管强化学习在许多领域取得了显著的研究成果和应用效果,但还存在一些挑战和问题需要解决:

- 样本效率:强化学习可能需要大量的训练样本才能达到较好的性能,因此如何在数据稀缺的情况下有效地训练模型是一个挑战。

- 探索与利用的平衡:在强化学习中,需要平衡对新情况的探索和已有知识的利用。如何在探索与利用之间找到合适的平衡是一个挑战。

- 泛化能力:强化学习中的模型往往在训练环境中表现良好,但在新环境中的表现却不尽如人意。如何提高模型的泛化能力是一个关键问题。

随着深度学习和强化学习的不断发展和进步,我们有理由相信,强化学习将在各个领域发挥更重要和更广泛的作用,为人类带来更多的便利和进步。

chatgpt训练的常见问答Q&A

ChatGPT的强化学习训练方法是什么?

ChatGPT的强化学习训练方法主要分为以下几个步骤:

- 预训练阶段:使用Transformer结构在大规模的互联网语料库上进行无监督学习,让ChatGPT学习到丰富的语言知识和上下文关联性。

- 微调阶段:在预训练模型的基础上,使用有监督学习的方法进行微调。通过输入输出对的训练数据,让ChatGPT在特定任务上学习到更加准确的回答。

- 奖励建模阶段:引入奖励模型(Reward Model),代替人工评分,降低标注成本。通过与人类演示者的交互和奖励信号,让ChatGPT改进生成结果,提高模型训练的效果。

- 强化学习阶段:使用参数优化算法,如PPO(Proximal Policy Optimization),让ChatGPT根据奖励信号调整自身的策略,以达到与人类交互时更优秀的表现。